Регулирование искусственного интеллекта международными организациями как фактор обеспечения технологической безопасности в национальных юрисдикциях

Лев М.Ю.1, Лещенко Ю.Г.2, Медведева М.Б.3

1 Российская Академия Естественных Наук, ,

2 Первое экономическое издательство, ,

3 Финансовый университет при Правительстве Российской Федерации, ,

Скачать PDF | Загрузок: 91

Статья в журнале

Экономическая безопасность (РИНЦ, ВАК)

опубликовать статью | оформить подписку

Том 7, Номер 8 (Август 2024)

Эта статья проиндексирована РИНЦ, см. https://elibrary.ru/item.asp?id=72103210

Аннотация:

В работе рассмотрено регулирование ИИ международными организациями как фактор обеспечения технологической безопасности в национальных юрисдикциях. Определены направления регулирования ИИ международными организациями. Разработан универсальный алгоритм действий в области регулирования ИИ, который позволит:

– снизить уровень рисков;

– обеспечить ответственность разработчиков за этическое и ответственное внедрение технологий ИИ;

– укрепить общественное доверие путем прозрачного регулирования систем ИИ;

– содействовать инновациям, учитывающих широкий спектр влияния приложений ИИ.

На примере США, России и Китая проанализировано текущее положение национальных стратегий/политик/инициатив в области ИИ.

Сделан вывод о том, что глобальный характер ИИ обуславливает сотрудничество между странами в рамках международных организаций, и становится все более важным для содействия процессу разработки международных принципов/стандартов ИИ, а также обеспечения технологической безопасности в национальных юрисдикциях

Ключевые слова: регулирование, технологии искусственного интеллекта, международные организации, ООН, ВОЗ, Всемирный банк, ОЭСР, БРИКС, G-20, технологическая безопасность, национальные юрисдикции

JEL-классификация: O31 O32 O 33

Введение. В большинстве стран законы, регулирующие искусственный интеллект (ИИ), все еще находятся на стадии разработки, а имеющиеся правила не являются универсальным и инклюзивным. В связи с этим возникает необходимость их гармонизации как на национальном, так и на международном уровнях.

«Искусственный интеллект, создание компьютерных систем, которые могут учиться и принимать решения без необходимости человеческого интеллекта, имеют потенциал для стимулирования инноваций в различных секторах экономики» [7]. На рынок выходит все больше товаров и услуг, созданных на базе технологий ИИ по мере того, как исследования в данной области продолжают развиваться. Например, ИИ уже применяется во многих аспектах современной жизни, включая беспилотные автомобили, цифровые помощники и технологии в здравоохранении. В современных условиях, одной из значимых причин создания стандартов регулирования ИИ со стороны международных организаций стало осознание возможных рисков, связанных с потенциальными злоупотреблениями и непредвиденными последствиями деятельности ИИ, а также необходимостью обеспечения технологической безопасности в национальных юрисдикциях [4; 6].

По мнению большинства экспертов и политиков, на международном уровне в сфере ИИ уже сейчас требуется сформировать определенную политику регулирования, в связи с гигантским ростом вычислительных мощностей, появлением новых стартапов в области ИИ. К тому же, объем данных о частных лицах, которые компании аккумулируют, увеличивается в геометрической прогрессии. В рамках дискуссий о будущих контурах регулирования и методах его внедрения, национальные правительства сотрудничают с международными организациями и крупными корпорациями.

Между тем, компании, использующие персональные данные для ИИ, могут столкнуться с серьёзными проблемами при соблюдении международных правил защиты данных, так как в каждой стране действуют особые законы и правила в области ИИ, регулирующие сбор, использование, обработку, раскрытие и безопасность персональных данных. Кроме того, трансграничная передача персональных данных может быть запрещена определенными национальными правилами. Таким образом, технологическое влияние ИИ на окружающую среду делает его регулирование жизненно важным для устойчивого будущего, а настоящее исследование актуальным.

Цель исследования: обосновать регулирование ИИ международными организациями как ключевой фактор обеспечения технологической безопасности в национальных юрисдикциях.

Задачи исследования:

– определить направления регулирования ИИ международными организациями;

– разработать универсальный алгоритм действий в области регулирования ИИ;

– на примере США, России и Китая проанализировать текущее положение национальных стратегий/политик/инициатив в области ИИ.

Новизна исследования заключается:

– в предложении авторов выделить значимые направления регулирования ИИ международными организациями как ключевого фактора обеспечения технологической безопасности в национальных юрисдикциях;

– в разработке универсального алгоритма действий в области регулирования ИИ.

Практическая значимость. Положения и выводы исследования могут быть использованы при создании международных нормативных актов, составляющих основу правового режима использования ИИ, а также для разработки национального законодательства, способствующего обеспечению технологической безопасности.

Направления регулирования ИИ международными организациями. В марте 2024 г. Генеральная Ассамблея Организации Объединенных Наций (Генеральная Ассамблея ООН/UN General Assembly) приняла Резолюцию A/78/L.49 «Использование возможностей безопасных, защищенных и надежных систем ИИ для устойчивого развития» [39]. Этот документ был разработан в сотрудничестве со 120 странами, и направлен на расширение участия развивающихся стран в цифровой трансформации, их возможности подключения к цифровой инфраструктуре и предоставления доступа к технологическим инновациям. Принятие Резолюции A/78/L.49 стало результатом многолетних докладов и инициатив ООН, изучающих последствия ИИ для прав человека, этики и достижения Целей устойчивого развития ООН (UN Sustainable Development Goals) [5], включая Рекомендацию ООН по вопросам образования, науки и культуры (ЮНЕСКО/UNESCO) по этике ИИ 2021 г. [38]. Рекомендация ЮНЕСКО позиционируется как инструмент «мягкого права», и не имеет обязательной силы. Этичное применение ИИ интерпретируется организацией следующим образом: «систематическое нормативное осмысление этических аспектов ИИ на основе эволюционирующей комплексной и многокультурной системы взаимосвязанных ценностных установок, принципов и процедур, способное ориентировать общество в вопросах ответственного учета известных и неизвестных последствий применения технологий ИИ, а также служить основой для принятия решений, касающихся применения или отказа от использования технологий на основе ИИ» [38].

В Резолюции Генеральной Ассамблеи ООН подчеркивается, что права человека должны соблюдаться, защищаться и поощряться на протяжении всего жизненного цикла систем ИИ, призывая страны воздерживаться от использования ИИ, не соответствующего законодательству о правах человека или создающего «неоправданные риски». Резолюция также призывает страны внедрять национальные структуры управления, способствующие ответственным, инклюзивным инновациям ИИ, согласованным с международным правом. Это включает следующие меры: оценка воздействия, гарантии защиты данных, требования прозрачности, надзор человека и инструменты для выявления контента, манипулируемого ИИ, недопущение предвзятости в процессе сбора данных, и применении соответствующих алгоритмах.

Резолюция Генеральной Ассамблеи ООН предлагает заинтересованным сторонам из всех стран и регионов, в рамках их соответствующих ролей и обязанностей, разрабатывать и поддерживать подходы и структуры регулирования/управления, связанные с безопасными, надежными и заслуживающими доверия системами ИИ, которые создают благоприятную экосистему на всех уровнях. В документе также отмечается важность дальнейшего обсуждения изменений в области регулирования ИИ, чтобы гарантировать соответствие международных подходов современным тенденциям развития систем ИИ и их использования.

Помимо принятой Резолюции, ООН уделяет значительное внимание изучению новых технологий ИИ, ежегодно публикуя доклад о своей деятельности в этой области – «United Nations Activities on Artificial Intelligence AI». В серии докладов представлены результаты деятельности всех специализированных учреждений ООН, которые так или иначе связаны с использованием технологий ИИ и обеспечивают разработку международных стандартов применения ИИ в определённых сферах [40]. Кроме того, в 2021 г. ООН выпустила «Руководство по стратегиям в области ИИ» (Resource Guide on AI), которое сформировано на базе ключевых ссылок по глобальному обзору в отношении стратегического регулирования ИИ [36].

Всемирная организация здравоохранения (ВОЗ/WHO) является специализированным учреждением в сфере здравоохранения международной системы ООН. ВОЗ располагает уникальной возможностью предоставлять рекомендации, наращивать потенциал, формировать программу исследований и привлекать заинтересованные стороны к совершенствованию этической основы использования больших данных (Big data) и ИИ в общественном здравоохранении [13]. ИИ открывает большие перспективы для здравоохранения, но также создает серьезные проблемы, включая неэтичный сбор данных, угрозы кибербезопасности и усиление предвзятости и дезинформации.

Потенциальные применения ИИ в здравоохранении аналогичны приложениям других форм ИИ, однако способы доступа являются новыми, с специфическими преимуществами и рисками, к которым национальные системы здравоохранения и конечные пользователи, возможно, еще не готовы в полной мере. В таблице 1 суммированы ключевые применения ИИ и его потенциальные преимущества и риски.

Таблица 1. Преимущества и риски ИИ в здравоохранении

|

Применение

|

Преимущества

|

Риски

|

|

Диагностика и

клиническое лечение

|

Помощь

в ведении сложных случаев и проверке диагнозов;

снижение коммуникационной нагрузки медицинских работников; предоставление новых идей и отчетов на основе неструктурированных форм данных о здоровье |

Неточные,

неполные или ложные ответы;

низкое качество данных обучения; предвзятость (обучающих данных и ответов); неполная автоматизация; деградация навыков (специалистов здравоохранения) |

|

Использование ИИ

под руководством пациента

|

Сгенерировать

информацию для улучшения понимания состояния здоровья;

виртуальный помощник по здоровью; запись на участие в клинических исследованиях |

Неполные

или ложные утверждения;

манипуляция; конфиденциальность; снижение взаимодействий между врачами и пациентами; риск оказания медицинской помощи за пределами системы здравоохранения |

|

Административные

задачи

|

Помощь

в оформлении документов, необходимых для лечения;

заполнение электронных медицинских карт; составление записей после визита к пациенту |

Неточности

и ошибки;

непоследовательные ответы в зависимости от подсказок |

|

Медицинское

образование

|

Динамические

тексты, соответствующие потребностям каждого учащегося;

имитация разговора для улучшения общения и практике в различных ситуациях, с разными пациентами; ответы на вопросы, сопровождаемые цепочкой рассуждений |

Игнорировать

неполную автоматизацию; ошибки или ложная информация подрывают качество

медицинского образования;

новое бремя изучения цифровых навыков |

|

Научные

исследования и разработка лекарств

|

Генерация

идей на основе научных данных и исследований;

создание текстов для использования в научных статьях, отправке рукописей и др.; анализ и обобщение данных для исследования; разработка лекарств |

Невозможно

привлечь алгоритмы к ответственности за контент;

подрывает ключевые принципы научных исследований; усугубляет дифференцированный доступ к научным знаниям |

Учитывая представленные данные в таблице 1, очевидно, что в практическом аспекте при использовании ИИ могут возникнуть более масштабные нормативно-правовые и системные риски. Одна из центральных проблем заключается в том, в какой степени ИИ может соблюдать существующие правовые и нормативные режимы, включая международные обязательства в области прав человека, а также национальные правила защиты данных. Более того, социальные риски, связанные с растущим использованием ИИ, заключаются в том, что его модели часто разрабатываются и внедряются крупными технологическими компаниями, что и без того может усиливать доминирование этих компаний над более мелкими структурами, а также и правительствами в отношении разработки и использования ИИ. С целью ограничения рисков и расширения возможностей в сфере здравоохранения, эксперты ВОЗ разработали следующие принципы в качестве основы для регулирования и управления ИИ [20]:

– соответствующая документация и ее прозрачность позволяют избегать предвзятости в подходах, и способствуют установлению доверия. Учитывая способность ИИ к самосовершенствованию, эксперты делают акцент на том, чтобы регуляторы отслеживали процесс разработки, и имели соответствующее документальное подтверждение проведения основных этапов проекта;

– управление рисками. Специалисты ВОЗ рекомендует использовать подход полного жизненного цикла для управления рисками;

– верификация. Аналитическая верификация определяется как процесс «валидации системы ИИ с использованием данных, но без проведения интервенционных или клинических исследований», а также может включать в себя сравнительный анализ, в ходе которого, разработанная модель сравнивается с другими инструментами и установленными стандартами производительности. Клиническая верификация – это процесс, посредством которого продукт или инструмент ИИ оценивается в контексте его предполагаемого использования;

– данные. Признавая данные ключевым компонентом для обучения алгоритмов ИИ/машинного обучения, специалисты ВОЗ подчеркивают сложность выявления и определения качественных данных, которая заключается в их множественности измерений, призывая регулирующие органы и разработчиков классифицировать данные на основе 10V: объем, достоверность, обоснованность, словарный запас, скорость, неопределенность, изменчивость, место проведения, разнообразие и ценность;

– взаимодействие и сотрудничество. Более интенсивное сотрудничество между всеми заинтересованными сторонами может повысить качество и безопасность ИИ в целом. Используя тематические исследования ряда органов здравоохранения по всему миру, эксперты призывают регулирующие органы позиционировать себя как посредников инноваций и партнеров в развитии. Поощряется широкая стратегия взаимодействия, включающая группы по защите прав пациентов, ученых, специалистов здравоохранения и других партнёров.

Всемирный банк (ВБ/WB) в 2020 г. опубликовал доклад: «Использование ИИ для развития: новая политика и нормативная база» (Harnessing Artificial Intelligence for Development A New Policy and Regulatory Framework) [42]. В докладе содержатся рекомендации для суверенных государств в отношении разработки стратегических документов в сфере ИИ и адаптации существующей регулятивной базы, в их числе:

– разработать дорожную карту/национальную стратегию с конкретизированными целями в области ИИ;

– создавать возможности для разработки и внедрения ИИ, включая глобальное развитие цифровой экономики;

– наращивать необходимый потенциал в национальных границах;

– объединять заинтересованные стороны в обсуждении вопросов развития ИИ;

– стимулировать спрос и создавать рыночные условия для развития ИИ;

– обеспечить этичную, безопасную и ответственную разработку и внедрение ИИ.

Кроме того, в рамках своей деятельности Всемирный Банк публикует большое количество исследовательских работ об опыте применения ИИ в различных областях экономики.

Обсуждения глобального регулирования ИИ стали постоянным пунктом повестки дня Большой двадцатки (G20 – The Group of Twenty) [9]. В 2019 г. G20 объявила о «Принципах G20 в области развития ИИ» («G20 AI Principles»), ставшие приложением к Совместному заявлению министров торговли и цифровой экономики G20 [23]. Одновременно с принятием «G20 AI Principles» была принята Осакская декларация лидеров стран G20, в которой отмечена важность ИИ в современном обществе: «ИИ при условии ответственного подхода к его разработке и использованию может стать движущей силой достижения Целей устойчивого развития (ЦУР) и создания инклюзивного общества» [24].

В 2016 г. Комитет Организации экономического сотрудничества и развития (ОЭСР/OECD) по политике в области цифровой экономики (OECD Committee on Digital Economy Policy) инициировал первые обсуждения о необходимости и важности создания рекомендаций Совета OЭСР по принципам ИИ. В мае 2018 г. Комитет создал группу экспертов для реализации поставленной задачи, в структуре которой функционирует Рабочая группа в области ИИ (AIGO) [34]. В состав группы входят эксперты из стран-участниц OЭСР и аналитических центров, бизнеса, гражданского общества и других международных организаций. Деятельность AIGO посвящена:

– анализу инвестирования в исследования и разработки ИИ;

– анализу данных, инфраструктуры, программного обеспечения и знаний;

– разработке регламентов и релевантной документации;

– развитию навыков и рынка труда;

– международному сотрудничеству.

В 2019 г. страны-участницы ОЭСР утвердили принципы работы с технологиями ИИ на межправительственном уровне – «Руководящие принципы ИИ OECD» (OECD AI Principles) [33]. Главная цель руководящих принципов – способствовать эффективному развитию технологий ИИ, содействовать правительствам государств, разработчикам и частным лицам в этичной разработке и применении технологий ИИ. Руководящие принципы ИИ содержат 5 ключевых рекомендаций по созданию этичного и недискриминационного ИИ:

– ИИ должен повышать недискриминационный рост и устойчивое социально-экономическое развитие;

– технологии ИИ должны разрабатываться с учетом требований применимого законодательства, обеспечения и защиты прав человека, демократических ценностей и многообразия;

– работа ИИ должна быть прозрачной и понятной для людей;

– технологии ИИ должны работать надежно и безопасно в течение всего жизненного цикла; такие технологии должны постоянно оцениваться на предмет потенциального риска причинения вреда человеку;

– организации и люди, которые разрабатывают, внедряют, управляют технологиями ИИ, должны нести ответственность за адекватное и точное функционирование таких технологий.

В феврале 2020 г. OЭСР запустила онлайн-платформу «Обсерватория политики ИИ OЭСР» (OECD AI Policy Observatory/OECD.AI), которая обеспечивает: [32]:

– обзор ситуации в странах и инструментов. Имеется интерактивная база данных стратегических документов, а также разрабатываемых инициатив в сфере ИИ из разных стран в целях укрепления международного сотрудничества и создания передового опыта;

– обзор принципов ИИ OЭСР: детализированная информация о Руководящих принципах ИИ;

– обзор политик: анализ стратегических документов на предмет интеграции во все сферы государственного управления;

– обзор тенденций: анализ тенденций развития ИИ.

Главная цель онлайн-платформы «Обсерватории политики ИИ OЭСР» – обеспечить разработку и внедрение этичного и недискриминационного ИИ.

В феврале 2022 г. онлайн-платформа «Обсерватория политики ИИ OЭСР» представила инструмент по классификации систем ИИ с целью реализации эффективной политики в этой области (OECD Framework for the Classification of AI Systems: a tool for effective AI policies). Данный инструмент разработан для оценки потенциальных рисков применения ИИ и своевременного отражения её результатов в стратегических документах по ИИ [35].

Страны БРИКС (BRICS) последовательно разрабатывают нормативно-правовые акты, посвященные ключевым аспектам цифровизации и ИИ как основным составляющим долгосрочного развития общества. Одним из важнейших правовых актов БРИКС в этих областях является Меморандум о взаимопонимании по сотрудничеству в области науки, технологий и инноваций, принятый в 2015 г. [11; 12].

Сотрудничество стран БРИКС в сфере ИИ закреплено в Декларации Гоа, принятой на VIII саммите БРИКС в 2016 г. [16]. В ходе VIII саммита БРИКС была принята Совместная программа развития и План действий по информационно-коммуникационным технологиям (Joint IT action plan) [25].

Приоритетным документом БРИКС, который отмечает важность ИИ в современном мире, стала «Инициатива цифрового экономического развития» (the Digital Economic Development Initiative) [15]. Данный документ был принят деловым советом БРИКС на саммите в Сямыне в 2017 г. В рамках саммита была предложена инициатива по созданию рабочей группы по цифровой экономике, где обсуждались вопросы, связанные с кибербезопасностью, технологиями ИИ, Интернетом вещей и аналитикой больших данных.

Предложение в отношении разработки единых этических принципов и рекомендаций нашло свое отражение в Пекинской Декларации XIV саммита БРИКС (XIV BRICS Summit Beijing Declaration) в 2022 г. Данная Декларация закрепляет важность [10]:

– сотрудничества в интересах укрепления доверия и безопасности, а также прозрачности и подотчетности в развитии надежного ИИ;

– поиска путей минимизации рисков и этических проблем, связанными с ИИ (неприкосновенность частной жизни, манипулирование, предвзятость, взаимодействие человека и робота, трудоустройство, последствия и сингулярности).

И несмотря на то, что обсуждение этических рамок ИИ также включено в повестку дня России в рамках БРИКС на 2024 г., неясно, согласятся ли новые государства-члены (Египет, Иран, ОАЭ, Эфиопия) или государства учредители (Бразилия, Индия, Китай, Россия, ЮАР) на совместные этические принципы в отношении собственного использования ИИ [8]. Невыполнение этого требования может подорвать способность стран БРИКС продвигать общую повестку дня в области ИИ на глобальном уровне.

Таким образом, учитывая глобальный характер ИИ, сотрудничество между странами в рамках международных организаций становится все более важным для содействия обсуждению международных принципов/стандартов ИИ и обеспечения технологической безопасности в национальных юрисдикциях. Целью подобного сотрудничества является создание системного подхода к управлению технологий ИИ, выходящего за рамки национальных юрисдикций. Данный подход сможет гарантировать, что регулирование не будет перекошено в пользу отдельных отраслей, а вместо этого создаст равные условия для всех секторов, использующих ИИ. На основании этого, авторами предлагается универсальный алгоритм действий – «Регулирование ИИ» в контексте: что, зачем и как регулировать? (табл. 2).

Таблица 2. Универсальный алгоритм действий – «Регулирование ИИ»

|

Что

регулировать в сфере ИИ?

| |

|

Прозрачность и

интерпретируемость

| |

|

Зачем?

|

Как?

|

|

Чтобы

гарантировать прозрачность и объяснимость систем ИИ.

Чтобы пользователи и заинтересованные стороны понимали, как принимаются решения. |

Нормативные

акты могут требовать четкой документации по проектированию, процессам

принятия решений и потенциальным предубеждениям моделей ИИ.

|

|

Предвзятость и

справедливость

| |

|

Для

устранения и минимизации предвзятости в алгоритмах ИИ.

Для обеспечения справедливости в сборе данных, обучении моделей и результатах. |

Установить

стандарты для выявления и устранения предвзятости в системах ИИ, а также

руководящие принципы справедливой и беспристрастной разработки ИИ.

|

|

Конфиденциальность

данных

| |

|

Для

защиты конфиденциальности пользователей и установления правил этичного сбора,

хранения и обработки персональных данных системами ИИ.

|

Разработать

правила, соответствующие текущим законам о защите данных и обеспечивающие

безопасную обработку конфиденциальной информации.

|

|

Безопасность

| |

|

Для

предотвращения несанкционированного доступа, утечек данных и кибер-атак на

системы ИИ.

|

Внедрить

правила, требующие надежных мер кибербезопасности, шифрования и регулярных

проверок безопасности для приложений ИИ.

|

|

Приложения с

высоким уровнем риска

| |

|

Сосредоточить

усилия регуляторов на приложениях со значительными потенциальными рисками.

|

Ввести

дополнительные требования к проверке и соблюдению требований к

высокорискованным приложениям ИИ.

|

|

Зачем

регулировать ИИ?

| |

|

Этические

соображения

| |

|

Для

обеспечения соответствия технологий общественным ценностям и этическим

нормам.

|

Интегрировать

этические принципы в нормативную базу, делая упор на ответственные инновации.

|

|

Общественное

доверие

| |

|

Формирование

и поддержание общественного доверия к технологиям ИИ путем установления

четких правил, этических стандартов и механизмов подотчетности.

|

Обеспечивать

прозрачную коммуникацию, вовлекать общественность в процесс принятия

регулятивных решений.

|

|

Стимулирование

инноваций

| |

|

Поощрять

ответственные и этичные инновации в области ИИ путем предоставления

нормативных стимулов организациям, которые придерживаются этических

принципов.

|

Разработать

правила, которые поощряют организации за ответственную практику ИИ.

Потенциально предлагать налоговые льготы или упрощенные процессы утверждения.

|

|

Как

регулировать ИИ?

| |

|

Адаптивные

нормативные рамки

| |

|

Разрабатывать

адаптивные фреймворки, которые могут развиваться вместе с технологическими

достижениями.

|

Гарантировать,

что нормативные акты останутся актуальными и эффективными в условиях быстрого

развития ИИ.

|

|

Международное

сотрудничество

| |

|

Развивать

сотрудничество с международными партнерами для установления общих стандартов

и норм разработки и использования ИИ.

|

Признавать

глобальный характер технологий ИИ и предотвращать фрагментацию регулирования.

|

|

Непрерывный

мониторинг

| |

|

Установить

процессы для постоянного мониторинга и оценки систем ИИ в реальных сценариях.

|

Позволит

регулирующим органам принимать нормативные акты на основе реальных показателей

и возникающих проблем.

|

|

Образование и

осведомленность

| |

|

Продвигать

правила, которые поддерживают образовательные и информационные программы.

Обеспечить информирование заинтересованных сторон о последствиях технологий

ИИ.

|

Улучшает

понимание ИИ и способствует ответственной разработке и использованию.

|

Предложенный авторами универсальный алгоритм действий – «Регулирование ИИ» позволит:

– снизить уровень рисков (устранение потенциальных рисков, связанных с предвзятостью, нарушением конфиденциальности и безопасности в системах ИИ);

– обеспечить ответственность (привлечение разработчиков к ответственности за этическое и ответственное внедрение технологий ИИ);

– укрепить доверие (укрепление общественного доверия путем прозрачного регулирования систем ИИ и обеспечения соответствия общественным ценностям);

– содействовать инновациям (поощрение ответственных инноваций, учитывающих более широкое общественное влияние приложений ИИ).

Регулирование ИИ в национальных юрисдикциях. Глобальные перспективы регулирования ИИ раскрывают динамичный ландшафт, сформированный разнообразными подходами, культурными нюансами и постоянным стремлением к этичному и ответственному развитию ИИ. В этой связи, на примере США, России и Китая, проанализируем текущее состояние национальных стратегий/политик/инициатив в области ИИ.

США. По состоянию на январь 2024 г. в США не сформирован обязательный федеральный закон, специально регулирующий разработку, внедрение и использование ИИ. Существующие законы, связанные с ИИ, касаются лишь административных вопросов, например, «Закон об обучении ИИ» [14]. Кроме того, анализируя регулирование ИИ в США необходимо учитывать следующие структурные факторы:

– Конституция США (Constitution of the United States) разделяет полномочия между федеральным правительством и правительствами штатов [19], что усложняет единый подход к регулированию ИИ. Например, федеральное правительство управляет одними вопросами (оборона, внешняя политика), правительства штатов другими (образование, здравоохранение). ИИ затрагивает различные сферы, находящиеся в ведении разных органов власти, создавая сложный и фрагментированный ландшафт;

– законодательный процесс в США, требующий одобрения законопроектов обеими палатами Конгресса, затрудняет принятие законов, особенно в быстро развивающейся области ИИ;

– технологическая индустрия США оказывает значительное влияние на обсуждения вопросов регулирования ИИ ввиду ее существенного вклада в ВВП страны и развитие ИИ. Объясняется это тем, что федеральное правительство одобрило добровольные рамки, которые в определённой степени позволяют технологической отрасли саморегулироваться и избегать любого потенциального подрыва ее позиций.

Тем не менее, несколько государственных учреждений имеют структуры для продвижения ответственного проектирования, разработки и использования ИИ:

– в октябре 2022 г. Белый дом (White house) опубликовал «Проект Билля о правах ИИ» [14], в котором изложены пять принципов, направленных на то, чтобы сделать автоматизированные системы безопасными, недискриминационными, прозрачными и уважающими конфиденциальность. Федеральные агентства США, такие как Министерство обороны, Агентство по международному развитию, Комиссия по трудоустройству и Министерство юстиции, имплементировали эти принципы в свою деятельность;

– в январе 2023 г. Национальный институт науки и технологий (NIST) опубликовал «Структуру управления рисками ИИ» [26], которая содержит рекомендации для организаций по снижению рисков на протяжении всего жизненного цикла системы ИИ;

– в октябре 2023 г. президент США издал указ о продвижении безопасного и ответственного ИИ [41]. Примечательно, что в указе содержится ссылка на Закон о оборонном производстве, который дает президенту полномочия отдавать приказы компаниям производить товары и услуги для поддержки национальной обороны США.

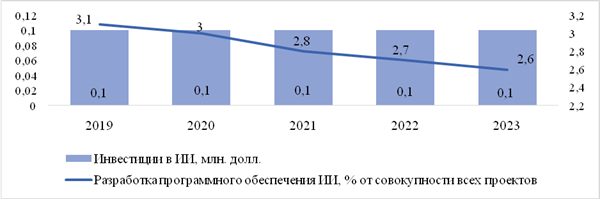

На уровне штатов, регулирование ИИ также запутанное и сложное, поскольку каждый штат действует по-своему. Согласно отчету – AI Index Report 2023 [12], в тройку лидеров по количеству законопроектов, связанных с ИИ, принятых в период 2016-2022 гг. входят Мэриленд, Калифорния и Массачусетс, логично учитывая тот факт, что эти штаты являются центрами исследований и инноваций в области ИИ. Более того, масштаб инвестиций в ИИ в США (рис. 1) многогранен и широк, охватывая технологические измерения и отрасли промышленности, а также широкий круг заинтересованных сторон.

Рисунок 1. Ключевые показатели ИИ в США

Источник составлено авторами по материалам OECD.AI [30].

Как видно из рисунка 1, инвестиции в ИИ за анализируемый период 2019-2023 гг. имеют положительную динамику, прирост составил 285 млн. долл.

Разработка программного обеспечения ИИ за период 2019-2021 гг. имеет отрицательный тренд (-3% от совокупности всех проектов), обусловленный пандемическим кризисом. За период 2021-2023 гг. отмечено увеличение на 2% от совокупности всех проектов.

Россия. С 2019 г. в России действует Указ Президента РФ № 490 «О развитии ИИ в РФ» вместе с «Национальной стратегией развития ИИ на период до 2030 г.», актуализированный в 2024 г. [1], в котором закреплены основные принципы развития и использования технологий ИИ:

– обеспечение защиты прав и свобод человека, гарантированных законодательством РФ, международными договорами РФ и нормами международного права;

– объяснимость работы ИИ и процесса достижения им результатов;

– обеспечение технологического суверенитета РФ в области ИИ;

– обеспечение взаимодействия научных исследований и разработок в области ИИ;

– развитие рыночных отношений и недопустимость действий, направленных на монополизацию и ограничение конкуренции между российскими организациями, осуществляющими деятельность в области ИИ;

– обеспечение постепенного перехода органов публичной власти к использованию технологий ИИ;

– безопасность и правовая охрана технологий ИИ;

– методологическое и технологическое обеспечение достоверности исходных данных в моделях ИИ.

Основным инструментом реализации «Национальной стратегии развития ИИ на период до 2030 г.» является Федеральный проект «Искусственный интеллект» (далее – федеральный проект) [3], предусматривающий пакет мер, направленный на поддержку компаний-разработчиков ИИ-решений и апробаций таких решений на российских предприятиях, повышение кадрового обеспечения, развитие системы науки и образования, формирование инфраструктуры для развития отечественного ИИ. Ряд результатов федерального проекта связан с ведомственными программами цифровой трансформации, в связи с чем финансируется за счёт средств национальной программы «Цифровая экономика РФ» (табл. 3).

Таблица 3. Финансовое обеспечение реализации федерального проекта

«Искусственный интеллект»

|

Объем финансового обеспечения

по годам реализации

|

Всего

(тыс. рублей) | |||

|

2021

|

2022

|

2023

|

2024

| |

|

7 123 942,2

|

10 395 476,2

|

9 416 790,8

|

9 376 790,8

|

36 313 000,0

|

Как видно из таблицы 3, объем финансового обеспечения за период 2021-2023 гг. имел скачкообразный тренд, на 2024 г. предусмотрено 9 376 790,8 руб., что на 40 000 руб. меньше чем в 2023 г.

Федеральный проект также связан с реализацией шести государственных программ РФ: «Информационное общество»; «Научно-технологическое развитие Российской Федерации»; «Развитие образования»; «Развитие промышленности и повышение её конкурентоспособности»; «Развитие электронной и радиоэлектронной промышленности»; «Экономическое развитие и инновационная экономика».

Однако, несмотря на активную работу в сфере ИИ, по данным онлайн-платформы «Обсерватория политики ИИ OЭСР», инвестиции в ИИ в России за последние пять лет находятся на стабильно низком уровне – 0,1 млн. долл. (рис. 2).

Рисунок 2. Ключевые показатели ИИ в России

Источник составлено авторами по материалам OECD.AI [31].

Показатель – «разработка программного обеспечения ИИ» за период 2019-2023 гг. также, как и показатель «инвестиции в ИИ» продемонстрировал низкий уровень значений с отрицательной тенденцией. Снижение составило 0,5% от совокупности всех проектов (рис. 2).

Китай. В стране с 1981 г. функционирует Китайская ассоциация ИИ (CAAI/中国人工智能学会) [18]. В настоящее время это единственная академическая ассоциация национального уровня в области науки и технологий ИИ, официально уполномоченная Министерством гражданских дел Китая. Цель CAAI – поддержка исследований в области ИИ. Прямыми бенефициарами CAAI являются: известные исследователи, учёные, докторанты, аспиранты и Государственные научно-исследовательские институты.

CAAI имеет 61 филиал, включая 52 профессиональных и 9 рабочих комитетов в области науки и технологий (организационная структура представлена в табл. 4).

Таблица 4. Организационная структура CAAI

|

CAAI

| |

|

Совет Ассоциации

|

Наблюдательный

Совет

|

|

Постоянный

Совет

| |

|

Секретариат

|

Профессиональный

комитет

|

|

Рабочий

комитет

| |

|

Высшее

руководство

|

|

|

Сервисная

служба

| |

|

Популяризация

науки и консультации по технологиям

| |

|

Обучение и

сертификация

| |

|

Издательское

дело и редактирование

| |

|

Информация и

медиареклама

| |

|

Научно-технический

обмен и международное сотрудничество

| |

Организационная структура позволяет CAAI успешно организовывать международные конференции по технологиям ИИ, и выпускать научные издания, такие как CAAI Transactions on Intelligent Systems (один из основных китайских журналов), CAAI Transactions on Intelligent Technology (внутренний журнал ассоциации), Association Briefings (специальное издание для молодых учёных) и AI Scholars (сборник онлайн-статей).

С 2017 г. в Китае реализуется «Национальный план по развитию нового поколения ИИ» (新一代人工智能发展规划) под руководством Государственного Совета Китайской Народной Республики (КНР) [37]. Национальный план включает инициативы и цели в области НИОКР, индустриализации, развития талантов, образования и приобретения навыков, установления стандартов и правил, этических норм и безопасности. Приоритетными целями национального плана являются:

– вывести китайскую отрасль ИИ на высокий уровень конкуренции;

– достичь «мирового лидерства» в определённых областях ИИ к 2025 г.;

– стать основным центром инноваций в области ИИ к 2030 г.

С 2018 г. в Китае действует «План действий по инновациям ИИ для высших учебных заведений» (高等学校人工智能创新行动计划) [27] под руководством Министерства образования КНР. В Плане действий изложены цели, направленные на существенное расширение кадрового состава, оптимизацию инфраструктуры колледжей/университетов и улучшение образовательных программ в области ИИ к 2030 г.

В 2019 г. Министерством науки и технологий КНР представлены «Принципы управления ИИ нового поколения – разработка ответственного ИИ» (新一代人工智能治理原则 – 发展负责任的人工智能) [21], позиционируя следующие цели:

– улучшить координацию взаимоотношений между разработкой и управлением ИИ;

– обеспечить безопасность и контролируемость ИИ;

– содействовать экономическому, социальному и экологическому устойчивому развитию.

Также в 2019 г., Министерство науки и технологий КНР организовало «Национальную пилотажную зону инноваций и развития ИИ нового поколения(国家新一代人工智能创新发展试验区) [28]. Пилотажная зона сосредоточена на изучении инновационной системы для разработки технологий ИИ и запуске платформ для его применения путем координации усилий правительства, академических кругов и промышленности.

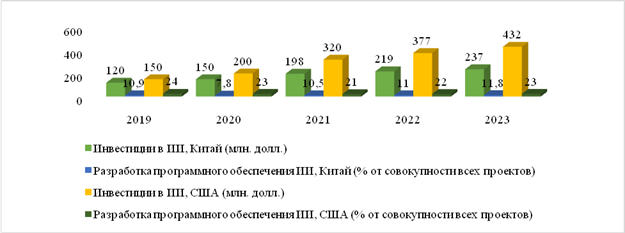

За последнее десятилетие Китай создал прочную основу для поддержки своей экономики ИИ, и внес значительный вклад в ИИ во всем мире. По данным многочисленных источников, Китай и США являются лидерами в глобальной конкуренции в области ИИ, хотя первый уступает второму по ключевым показателям («Инвестиции в ИИ», «Разработка программного обеспечения ИИ»), (рис. 3).

Рисунок 3. Ключевые показатели ИИ в Китае и США

Источник составлено авторами по материалам OECD.AI [29; 30].

Как видно из рисунка 3, за анализируемый период 2019-2023 гг. «инвестиции в ИИ» и в Китае, и в США продемонстрировали положительные тенденции роста с ежегодным увеличением. Однако, по исследуемым годам, инвестиции США превышают инвестиции Китая: в 2019 г. на 30 млн. долл., в 2020 г. на 50 млн. долл., в 2021 г. на 122 млн. долл., в 2022 г. на 158 млн. долл., в 2023 г. на 195 млн. долл.

Значения показателя «разработка программного обеспечения ИИ» США также превышают значения Китая: в 2019 г. на 13,1% от совокупности всех проектов, в 2020 г. на 15,2% от совокупности всех проектов, в 2021 г. на 10,5% от совокупности всех проектов, в 2022 г. на 11% от совокупности всех проектов, в 2023 г. на 11,2% от совокупности всех проектов.

Заключительные выводы

1. Нормативно-правовой ландшафт ИИ – это новая проблема в национальных юрисдикциях, в том числе для международных организаций с прямыми полномочиями по обеспечению соблюдения требований. ИИ совершил значительный скачок в эксплуатационных возможностях, ознаменовав начало очередной промышленной революции. Между тем, наблюдается всплеск неправомерного использования ИИ. В ответ на этические проблемы ИИ во всем мире были предприняты законодательные меры. Ключевыми направлениями регулирования ИИ международными организациями являются:

– важность обеспечения технологической безопасности, защищенности и этичного использования систем ИИ;

– необходимость прозрачности в операциях и решениях ИИ;

– проблема устранения предвзятости и обеспечения справедливости в системах ИИ;

– роль международного сотрудничества в гармонизации регулирования ИИ.

2. В своевременных документах международных организаций излагаются основные принципы, на которых регуляторы национальных юрисдикций начинают формировать свои нормативные базы. Общим для всех регуляторов является важность и акцент на прозрачности, документации и эффективном управлении рисками. Согласование этих принципов имеет решающее значение, когда речь идет о международном сотрудничестве между заинтересованными сторонами, поскольку это может повысить качество ИИ и технологическую безопасность.

3. Так как спектр регулирования ИИ продолжает расширятся, взаимодействие между инновациями и регулированием остается приоритетной областью внимания. Разнообразные подходы к регулированию подчеркивают глобальную проблему гармонизации законов об ИИ для содействия международному сотрудничеству при соблюдении национальных правовых и культурных норм. Текущие разработки в регулировании ИИ сконцентрированы на важности адаптивных и нормативных рамок, которые могут учитывать быстрый технологический прогресс, и оптимизировать связанные с ним риски. Поскольку технологии ИИ все больше внедряются во все аспекты общества, эффективность этих нормативных актов будет играть решающую роль в формировании будущего развития ИИ и его интеграции в глобальную экономику.

Источники:

2. «Паспорт федерального проекта «Искусственный интеллект» национальной программы «Цифровая экономика Российской Федерации» (приложение N 3 к протоколу президиума Правительственной комиссии по цифровому развитию, использованию информационных технологий. [Электронный ресурс]. URL: https://www.consultant.ru/document/cons_doc_LAW_398627/ (дата обращения: 08.08.2024).

3. Аналитический центр при Правительстве РФ. Федеральный проект «Искусственный интеллект». [Электронный ресурс]. URL: https://ai.gov.ru/strategy/federalnyy-proekt-ii/?ysclid=lzlmybg8 (дата обращения: 08.08.2024).

4. Караваева И.В., Лев М.Ю. Экономическая безопасность: технологический суверенитет в системе экономической безопасности в современной России // Экономическая безопасность. – 2023. – № 3. – c. 905-924. – doi: 10.18334/ecsec.6.3.118475.

5. Лев М.Ю., Лещенко Ю.Г. Анализ концепции безопасности Организации Объединенных Наций в процессе глобальной интеграции // Экономическая безопасность. – 2022. – № 1. – c. 11-44. – doi: 10.18334/ecsec.5.1.113726.

6. Лев М.Ю., Медведева М.Б., Лещенко Ю.Г. Эволюция глобального управления экономическими процессами в контексте международных организаций с позиции национальной безопасности // Экономическая безопасность. – 2022. – № 4. – c. 1583-1614. – doi: 10.18334/ecsec.5.4.115231.

7. Лев М.Ю., Болонин А.И., Туруев И.Б., Лещенко Ю.Г. Концепция искусственного интеллекта в деятельности центральных банков: институциональные возможности // Экономическая безопасность. – 2024. – № 4. – c. 781-808. – doi: 10.18334/ecsec.7.4.120831.

8. Лев М.Ю., Медведева М.Б., Лещенко Ю.Г. Экономическая безопасность БРИКС в условиях антироссийских санкций: институциональный аспект // Экономическая безопасность. – 2024. – № 1. – c. 123-154. – doi: 10.18334/ecsec.7.1.120345.

9. Лещенко Ю.Г. Институциональные ориентиры группы 20 (G-20) в аспекте российской экономики и интересах российского предпринимательства // Российское предпринимательство. – 2017. – № 17. – c. 2417-2450. – doi: 10.18334/rp.18.17.38255.

10. Пекинская декларация XIV саммита БРИКС. [Электронный ресурс]. URL: http://www.kremlin.ru/supplement/5819 (дата обращения: 30.07.2024).

11. Петренко Е.С., Варламов А.В., Лещенко Ю.Г. Экономическая безопасность и интересы России в БРИКС // Экономические отношения. – 2020. – № 4. – c. 1295-1312. – doi: 10.18334/eo.10.4.111398.

12. AI Index Report 2023. Measuring trends in Artificial Intelligence. [Электронный ресурс]. URL: https://aiindex.stanford.edu/ai-index-report-2023/ (дата обращения: 08.08.2024).

13. Big data and artificial intelligence for achieving universal health coverage: an international consultation on ethics. [Электронный ресурс]. URL: https://www.who.int/publications/i/item/WHO-HMM-IER-REK-2018-2 (дата обращения: 08.07.2024).

14. Bill to establish AI training programs for federal agency leaders progresses in Senate. [Электронный ресурс]. URL: https://fedscoop.com/bill-to-establish-ai-training-programs-for-federal (дата обращения: 08.08.2024).

15. BRICS Information Centre. BRICS Leaders Xiamen Declaration Xiamen, China, 4 September 2017. [Электронный ресурс]. URL: http://www.brics.utoronto.ca/docs/170904-xiamen.html (дата обращения: 30.07.2024).

16. BRICS Information Centre. Goa Declaration, VIII BRICS Summit, Goa, India, 16 October 2016. [Электронный ресурс]. URL: http://www.brics.utoronto.ca/docs/161016-goa.html (дата обращения: 30.07.2024).

17. Caa. CAAI Organization. [Электронный ресурс]. URL: https://en.caai.cn/index.php?s=/Home/Article/index/id/42.html (дата обращения: 10.08.2024).

18. Caai. Chinese Association for Artificial Intelligence. [Электронный ресурс]. URL: https://en.caai.cn/index.php?s=/Home/Article/index/id/2.html (дата обращения: 10.08.2024).

19. Constitution of the United States. [Электронный ресурс]. URL: https://constitution.congress.gov/constitution/ (дата обращения: 08.08.2024).

20. Ethics and governance of artificial intelligence for health: WHO guidance. [Электронный ресурс]. URL: https://www.who.int/publications/i/item/9789240029200 (дата обращения: 08.07.2024).

21. Generation Artificial Intelligence: Developing Responsible Artificial Intelligence. [Электронный ресурс]. URL: https://www.secrss.com/articles/11444 (дата обращения: 10.08.2024).

22. Government Decisions. Signing the Memorandum on Cooperation in Science, Technology and Innovation between the Governments of Russia, Brazil, India, China and South Africa. [Электронный ресурс]. URL: http://government.ru/en/docs/17313/ (дата обращения: 30.07.2024).

23. G20 Ministerial Statement on Trade and Digital Economy. [Электронный ресурс]. URL: https://wp.oecd.ai/app/uploads/2021/06/G20-AI-Principles.pdf (дата обращения: 27.07.2024).

24. G20 Osaka Leaders' Declaration. [Электронный ресурс]. URL: https://www.consilium.europa.eu/media/40124/final_g20_osaka_leaders_declaration.pdf (дата обращения: 27.07.2024).

25. Ministers of Communications and IT from BRICS countries adopted a joint development programme and an Action Plan on ICT at a meeting last week. [Электронный ресурс]. URL: https://www.rbth.com/world/2016/11/15/the-brics-have-a-joint-it-action-plan_647897 (дата обращения: 30.07.2024).

26. NIST Risk Management Framework Aims to Improve Trustworthiness of Artificial Intelligence (January 26, 2023). [Электронный ресурс]. URL: https://www.nist.gov/itl/ai-risk-management-framework (дата обращения: 08.08.2024).

27. Notice of the Ministry of Education on Issuing the «Action Plan for Artificial Intelligence Innovation in Higher Education Institutions» Education and Technology 2018 № 3. [Электронный ресурс]. URL: http://www.moe.gov.cn/srcsite/A16/s7062/201804/t20180410_332722.html (дата обращения: 10.08.2024).

28. Notice of the Ministry of Science and Technology on Issuing the «Guidelines for the Construction of National New Generation Artificial Intelligence Innovation and Development Pilot Zones». [Электронный ресурс]. URL: https://www.gov.cn/xinwen/2019-09/06/content_5427767.htm (дата обращения: 10.08.2024).

29. Oecd.ai. AI in China. [Электронный ресурс]. URL: https://oecd.ai/en/dashboards/countries/China (дата обращения: 08.08.2024).

30. Oecd.ai. AI in the United States. [Электронный ресурс]. URL: https://oecd.ai/en/dashboards/countries/UnitedStates (дата обращения: 08.08.2024).

31. Oecd.ai. National AI policies & strategies. [Электронный ресурс]. URL: https://oecd.ai/en/dashboards/overview (дата обращения: 08.08.2024).

32. Oecd.ai. Trends & data overview. [Электронный ресурс]. URL: https://oecd.ai/en/trends-and-data (дата обращения: 30.07.2024).

33. Oecd. OECD AI Principles overview. [Электронный ресурс]. URL: https://oecd.ai/en/ai-principles (дата обращения: 30.07.2024).

34. Oecd. Science, technology and innovation. [Электронный ресурс]. URL: https://www.oecd.org/innovation/oecd-creates-expert-group-to-foster-trust-in-artificial-intelligence.htm (дата обращения: 30.07.2024).

35. Oecd. The OECD Framework for the Classification of AI systems. [Электронный ресурс]. URL: https://wp.oecd.ai/app/uploads/2022/02/Classification-2-pager-1.pdf (дата обращения: 30.07.2024).

36. Resource Guide on Artificial Intelligence. [Электронный ресурс]. URL: https://sdgs.un.org/sites/default/files/2021-04/Resource%20Guide%20o (дата обращения: 07.07.2024).

37. The State Council issued Notice on the Development Plan of the New Generation of Artificial Intelligence (Guofa 2017 № 35). [Электронный ресурс]. URL: https://www.gov.cn/zhengce/content/2017-07/20/content_5211996.htm (дата обращения: 10.08.2024).

38. Unesco. Ethics of Artificial Intelligence. The Recommendation. [Электронный ресурс]. URL: https://www.unesco.org/en/artificial-intelligence/recommendation-ethics (дата обращения: 07.07.2024).

39. UN General Assembly (78 session). Seizing the opportunities of safe, secure and trustworthy artificial intelligence systems for sustainable development. [Электронный ресурс]. URL: file:///C:/Users/user/Downloads/2024%20Seizing%20the%20opportunities%20of%20safe,%20secure (дата обращения: 07.07.2024).

40. United Nations Activities on Artificial Intelligence (AI). [Электронный ресурс]. URL: https://www.itu.int/dms_pub/itu-s/opb/gen/S-GEN-UNACT-2021-PDF-E.pdf (дата обращения: 07.07.2024).

41. White house. FACT SHEET: President Biden Issues Executive Order on Safe, Secure, and Trustworthy Artificial Intelligence. [Электронный ресурс]. URL: https://www.whitehouse.gov/briefing-room/statements-releases/2023/10/30 (дата обращения: 08.08.2024).

42. World Bank. Harnessing Artificial Intelligence for Development: A New Policy and Regulatory Framework (English). [Электронный ресурс]. URL: https://documents1.worldbank.org/curated/en/326191582688955286/pdf/Harnessing (дата обращения: 27.07.2024).

Страница обновлена: 24.05.2026 в 22:04:04

Download PDF | Downloads: 91

Regulation of artificial intelligence by international organizations as a factor in ensuring technological security in national jurisdictions

Lev M.Y., Leshchenko Y.G., Medvedeva M.B.Journal paper

Economic security

Volume 7, Number 8 (August 2024)

Abstract:

The article examines the role of international organizations in regulating AI as a means of ensuring technological security at the national level. The regulatory approach to AI taken by international organizations has been established. The authors have developed a universal algorithm of actions in the field of AI regulation with the objective of reducing the level of risk, ensuring the responsibility of developers for the ethical and responsible implementation of AI technologies, strengthening public trust through transparent regulation of AI systems, and promoting innovations that take into account the wide range of impact of AI applications.

The article employs case studies of the USA, Russia, and China to examine the current national strategies, policies, and initiatives pertaining to AI. It is posited that the global nature of AI necessitates collaboration between countries within the framework of international organizations. This is becoming increasingly crucial to facilitate the development of international AI principles and standards, as well as to ensure technological security at the national level.

Keywords: regulation, artificial intelligence technology, international organization, UN, WHO, World Bank, OECD, BRICS, G20, technological security, national jurisdiction

JEL-classification: O31 O32 O 33

References:

AI Index Report 2023Measuring trends in Artificial Intelligence. Retrieved August 08, 2024, from https://aiindex.stanford.edu/ai-index-report-2023/

BRICS Information CentreBRICS Leaders Xiamen Declaration Xiamen, China, 4 September 2017. Retrieved July 30, 2024, from http://www.brics.utoronto.ca/docs/170904-xiamen.html

BRICS Information CentreGoa Declaration, VIII BRICS Summit, Goa, India, 16 October 2016. Retrieved July 30, 2024, from http://www.brics.utoronto.ca/docs/161016-goa.html

Big data and artificial intelligence for achieving universal health coverage: an international consultation on ethics. Retrieved July 08, 2024, from https://www.who.int/publications/i/item/WHO-HMM-IER-REK-2018-2

Bill to establish AI training programs for federal agency leaders progresses in Senate. Retrieved August 08, 2024, from https://fedscoop.com/bill-to-establish-ai-training-programs-for-federal

CaaCAAI Organization. Retrieved August 10, 2024, from https://en.caai.cn/index.php?s=/Home/Article/index/id/42.html

CaaiChinese Association for Artificial Intelligence. Retrieved August 10, 2024, from https://en.caai.cn/index.php?s=/Home/Article/index/id/2.html

Constitution of the United States. Retrieved August 08, 2024, from https://constitution.congress.gov/constitution/

Ethics and governance of artificial intelligence for health: WHO guidance. Retrieved July 08, 2024, from https://www.who.int/publications/i/item/9789240029200

G20 Ministerial Statement on Trade and Digital Economy. Retrieved July 27, 2024, from https://wp.oecd.ai/app/uploads/2021/06/G20-AI-Principles.pdf

G20 Osaka Leaders' Declaration. Retrieved July 27, 2024, from https://www.consilium.europa.eu/media/40124/final_g20_osaka_leaders_declaration.pdf

Generation Artificial Intelligence: Developing Responsible Artificial Intelligence. Retrieved August 10, 2024, from https://www.secrss.com/articles/11444

Government DecisionsSigning the Memorandum on Cooperation in Science, Technology and Innovation between the Governments of Russia, Brazil, India, China and South Africa. Retrieved July 30, 2024, from http://government.ru/en/docs/17313/

Karavaeva I.V., Lev M.Yu. (2023). Ekonomicheskaya bezopasnost: tekhnologicheskiy suverenitet v sisteme ekonomicheskoy bezopasnosti v sovremennoy Rossii [Economic security: technological sovereignty in the economic security system in modern Russia]. Economic security. 6 (3). 905-924. (in Russian). doi: 10.18334/ecsec.6.3.118475.

Leschenko Yu.G. (2017). Institutsionalnye orientiry gruppy 20 (G-20) v aspekte rossiyskoy ekonomiki i interesakh rossiyskogo predprinimatelstva [Institutional guidelines for the Group 20 (G-20) in the aspect of the Russian economy and the interests of Russian entrepreneurship]. Russian Journal of Entrepreneurship. 18 (17). 2417-2450. (in Russian). doi: 10.18334/rp.18.17.38255.

Lev M.Yu., Bolonin A.I., Turuev I.B., Leschenko Yu.G. (2024). Kontseptsiya iskusstvennogo intellekta v deyatelnosti tsentralnyh bankov: institutsionalnye vozmozhnosti [The concept of artificial intelligence in the activities of central banks: institutional opportunities]. Economic security. 7 (4). 781-808. (in Russian). doi: 10.18334/ecsec.7.4.120831.

Lev M.Yu., Leschenko Yu.G. (2022). Analiz kontseptsii bezopasnosti Organizatsii Obedinennyh Natsiy v protsesse globalnoy integratsii [Analysis of the United Nations security concept amidst global integration]. Economic security. 5 (1). 11-44. (in Russian). doi: 10.18334/ecsec.5.1.113726.

Lev M.Yu., Medvedeva M.B., Leschenko Yu.G. (2022). Evolyutsiya globalnogo upravleniya ekonomicheskimi protsessami v kontekste mezhdunarodnyh organizatsiy s pozitsii natsionalnoy bezopasnosti [The evolution of global economic governance in the context of international organisations from a national security perspective]. Economic security. 5 (4). 1583-1614. (in Russian). doi: 10.18334/ecsec.5.4.115231.

Lev M.Yu., Medvedeva M.B., Leschenko Yu.G. (2024). Ekonomicheskaya bezopasnost BRIKS v usloviyakh antirossiyskikh sanktsiy: institutsionalnyy aspekt [BRICS economic security amidst anti-Russian sanctions: an institutional aspect]. Economic security. 7 (1). 123-154. (in Russian). doi: 10.18334/ecsec.7.1.120345.

Ministers of Communications and IT from BRICS countries adopted a joint development programme and an Action Plan on ICT at a meeting last week. Retrieved July 30, 2024, from https://www.rbth.com/world/2016/11/15/the-brics-have-a-joint-it-action-plan_647897

NIST Risk Management Framework Aims to Improve Trustworthiness of Artificial Intelligence (January 26, 2023). Retrieved August 08, 2024, from https://www.nist.gov/itl/ai-risk-management-framework

Notice of the Ministry of Education on Issuing the «Action Plan for Artificial Intelligence Innovation in Higher Education Institutions» Education and Technology 2018 № 3. Retrieved August 10, 2024, from http://www.moe.gov.cn/srcsite/A16/s7062/201804/t20180410_332722.html

Notice of the Ministry of Science and Technology on Issuing the «Guidelines for the Construction of National New Generation Artificial Intelligence Innovation and Development Pilot Zones». Retrieved August 10, 2024, from https://www.gov.cn/xinwen/2019-09/06/content_5427767.htm

Oecd.aiAI in China. Retrieved August 08, 2024, from https://oecd.ai/en/dashboards/countries/China

Oecd.aiAI in the United States. Retrieved August 08, 2024, from https://oecd.ai/en/dashboards/countries/UnitedStates

Oecd.aiNational AI policies & strategies. Retrieved August 08, 2024, from https://oecd.ai/en/dashboards/overview

Oecd.aiTrends & data overview. Retrieved July 30, 2024, from https://oecd.ai/en/trends-and-data

OecdOECD AI Principles overview. Retrieved July 30, 2024, from https://oecd.ai/en/ai-principles

OecdScience, technology and innovation. Retrieved July 30, 2024, from https://www.oecd.org/innovation/oecd-creates-expert-group-to-foster-trust-in-artificial-intelligence.htm

OecdThe OECD Framework for the Classification of AI systems. Retrieved July 30, 2024, from https://wp.oecd.ai/app/uploads/2022/02/Classification-2-pager-1.pdf

Petrenko E.S., Varlamov A.V., Leschenko Yu.G. (2020). Ekonomicheskaya bezopasnost i interesy Rossii v BRIKS [Economic security and Russia's interests in BRICS]. Journal of international economic affairs. 10 (4). 1295-1312. (in Russian). doi: 10.18334/eo.10.4.111398.

Resource Guide on Artificial Intelligence. Retrieved July 07, 2024, from https://sdgs.un.org/sites/default/files/2021-04/Resource%20Guide%20o

The State Council issued Notice on the Development Plan of the New Generation of Artificial Intelligence (Guofa 2017 № 35). Retrieved August 10, 2024, from https://www.gov.cn/zhengce/content/2017-07/20/content_5211996.htm

UN General Assembly (78 session)Seizing the opportunities of safe, secure and trustworthy artificial intelligence systems for sustainable development. Retrieved July 07, 2024, from file:///C:/Users/user/Downloads/2024%20Seizing%20the%20opportunities%20of%20safe,%20secure

UnescoEthics of Artificial Intelligence. The Recommendation. Retrieved July 07, 2024, from https://www.unesco.org/en/artificial-intelligence/recommendation-ethics

United Nations Activities on Artificial Intelligence (AI). Retrieved July 07, 2024, from https://www.itu.int/dms_pub/itu-s/opb/gen/S-GEN-UNACT-2021-PDF-E.pdf

White houseFACT SHEET: President Biden Issues Executive Order on Safe, Secure, and Trustworthy Artificial Intelligence. Retrieved August 08, 2024, from https://www.whitehouse.gov/briefing-room/statements-releases/2023/10/30

World BankHarnessing Artificial Intelligence for Development: A New Policy and Regulatory Framework (English). Retrieved July 27, 2024, from https://documents1.worldbank.org/curated/en/326191582688955286/pdf/Harnessing