Управление внедрением искусственного интеллекта в центральных банках с учётом аспектов развития и безопасности

Скачать PDF | Загрузок: 34

Статья в журнале

Экономическая безопасность (РИНЦ, ВАК)

опубликовать статью | оформить подписку

Том 8, Номер 2 (Февраль 2025)

Эта статья проиндексирована РИНЦ, см. https://elibrary.ru/item.asp?id=82320708

Аннотация:

Актуальность исследования заключается в целесообразности интеграции технологий ИИ в деятельность центральных банков с учетом их влияния на финансово-экономическую стабильность, безопасность и социальную ответственность.

В работе представлен теоретический контекст ИИ и определены его преимущества относительно центральных банков. Идентифицированы риски центральных банков, связанные с принятием ИИ. Обоснована необходимость разработки стратегии управления рисками в области ИИ.

Рассмотрены международные стандарты в области ИИ, содержащие системное управление рисками. Учитывая существующие международные стандарты предложен комплекс мер по управлению внедрением ИИ в центральных банках с учётом аспектов развития и безопасности.

Сделан вывод, что международные стандарты и передовая практика позволят центральным банкам лучше интегрировать ИИ в свои структуры управления, гарантируя его безопасное, ответственное и этичное использование.

Ключевые слова: искусственный интеллект, развитие, безопасность, центральные банки, управление рисками

JEL-классификация: E58, E50, G32, L86

Введение. Искусственный интеллект (ИИ) имеет огромный потенциал в деятельности центральных банков. В то же время его внедрение влечет за собой сложные проблемы управления рисками. Варианты использования ИИ охватывают широкий спектр функций центрального банка, в их числе: анализ данных, финансовые исследования, экономическое прогнозирование, функционирование платежных инфраструктур, мониторинг технологических инноваций [1; 6]. В этой связи потенциальная подверженность риску для центральных банков может быть значительной ввиду критичности и конфиденциальности обрабатываемых ими информационных данных, а также их ключевого положения на финансовых рынках [7].

Управление внедрением ИИ в центральных банках – это сложный и многогранный процесс, требующий всестороннего подхода. Успешное внедрение ИИ может привести к значительным эффектам в области финансовой стабильности, однако следует уделять должное внимание вопросам безопасности, этики и правового регулирования. Необходимость защиты информации и обеспечения конфиденциальности становится особенно актуальной в условиях растущей зависимости от цифровых технологий. Следовательно, разработка надежных систем безопасности и протоколов реагирования на инциденты должна стать приоритетной задачей в деятельности финансовых регуляторов. В частности, центральные банки должны активно работать над созданием нормативных актов, регулирующих использование ИИ в финансовом секторе, устанавливать стандарты оценки и мониторинга алгоритмов, а также внедрять механизмы защиты прав потребителей.

Цель исследования заключается в обосновании необходимости управления внедрением ИИ в деятельности центральных банков с учётом аспектов развития и безопасности.

Задачи исследования:

– определить преимущества ИИ относительно центральных банков и варианты его использования;

– идентифицировать риски, связанные с принятием ИИ;

– предложить комплекс мер по управлению внедрением ИИ в центральных банках с учётом аспектов развития и безопасности.

Практическая значимость исследования заключается не только в теоретическом осмыслении вопросов внедрения ИИ, но и в создании инструментов и рекомендаций, которые могут быть непосредственно применены в практике центральных банков.

ИИ в деятельности центральных банков. Концепция ИИ охватывает широкий спектр идей, технологий и методов, направленных на создание систем, способных выполнять задачи, требующие человеческого интеллекта, и содержит в себе такие области, как машинное обучение (МО), обработка естественного языка (NLP), компьютерное зрение и робототехника.

Ньороге Л. (Njoroge Lucas) полагает, что «ИИ использует вычисления для искусственного создания интеллекта и описывается как способность машин имитировать человеческий интеллект» [16]. То есть, ИИ подразумевает набор инструментов, которые обучаются на основе имеющихся данных и понимают закономерности и взаимодействия между какими-либо значениями.

Бостром Н. выделяет «суперинтеллект», который сможет превзойти любого человека за счет увеличения мощностей и крайне быстрого самосовершенствования машины – «рекурсивного улучшения» [2]. Однако в текущих условиях подобные сценарии нереалистичны.

Шестак В.А. и Волеводз А.Г. в своей работе представили следующую классификацию технологий ИИ:

– реактивные машины, воспринимающие и реагирующие на окружающую среду, но не способные накапливать опыт, формировать память и принимать решения, основываясь на имеющемся опыте;

– системы с ограниченной памятью, способные учитывать наблюдения, некоторый накопленный опыт и информацию;

– разумные системы, которые могут иметь свои представления о мире, других агентах и сущностях;

– системы с самосознанием, которые могут осознавать себя, формировать представление о себе [9].

Очевидно, что две последние категории до сих пор остаются неоднозначно воспринимаемыми. Машина лишена способности себя осознавать, она не имеет глубоких ощущений. Так, если взять воспоминания человека и загрузить их в компьютер, то они будут представлять собой набор данных, в которых ИИ выявит определенные закономерности, что позволит ему прийти к какому-то результату. Вся же суть человеческих воспоминаний состоит в ощущениях и восприятии. ИИ способен генерировать результат, основываясь на алгоритмах и данных, без понимания и ощущения сути и глубоких смыслов этих процессов.

При этом многие эксперты идентифицируют ИИ как систему. Например, Бейкер-Бруннбауэр Й. (Baker-Brunnbauer Josef) определил ИИ следующим образом: «Системы ИИ – это программные (аппаратные) системы, действующие в цифровом измерении, которые воспринимают свою среду путем интерпретации собранных структурированных/неструктурированных данных, обрабатывают информацию, полученную из этих данных, и решают, какие действия лучше всего предпринять для достижения поставленной цели» [10]. Фактически, системный аспект ИИ охватывает множество компонентов и взаимодействий, обеспечивающих его функционирование и интеграцию в различные сферы жизни, включая как технические, так и организационные и этические элементы.

Специалисты ОЭСР (OECD) [1] придерживаются сопоставимой точки зрения Бейкер-Бруннбауэр Й.: «Система ИИ – это автоматизированная система, которая для явных или неявных целей делает выводы из получаемых ею входных данных о том, как генерировать выходные данные, такие как прогнозы, контент, рекомендации или решения, способные влиять на физическую/виртуальную среду» [15]. Между тем различные системы ИИ дифференцируются по уровню автономности и адаптивности после развертывания.

В последние годы ИИ стал востребованным инструментом в деятельности центральных банков, существенно влияя на их функции и процессы. Непосредственными преимуществами ИИ в их работе выступают:

– автоматизация рутинных процессов: внедрение ИИ в операционные процессы центральных банков позволяет автоматизировать повседневные (однообразные) задачи (обработка заявок, управление активами, мониторинг транзакций), что освобождает время сотрудников для более стратегических задач;

– оптимизация денежно-кредитной политики (ДКП): с помощью алгоритмов машинного обучения центральные банки могут моделировать различные сценарии и оценивать влияние своих решений на экономику, что способствует более рациональному управлению денежной массой и процентными ставками [3];

– улучшение анализа данных: ИИ способен обрабатывать и анализировать огромные объемы данных в реальном времени, что позволяет центральным банкам более точно определять экономическую ситуацию, прогнозировать инфляцию и выявлять финансовые риски;

– усиление борьбы с финансовыми преступлениями: ИИ может анализировать транзакции и выявлять подозрительные паттерны, что значительно улучшает возможности центральных банков в борьбе с отмыванием денег и другими финансовыми преступлениями;

– поддержка инновационных финансовых технологий: ИИ способствует развитию новых финансовых продуктов и услуг, например, цифровые валюты центральных банков (ЦВЦБ/CBDC), что позволяет совершенствовать финансовую инклюзивность и повышать эффективность платежных систем [5; 8].

Несмотря на потенциальные преимущества, внедрение ИИ сопряжено с определенными рисками. К ним относятся вопросы этики, кибербезопасности, защиты данных и возможные предвзятости в алгоритмах. Поэтому центральным банкам необходимо разрабатывать новые и пересматривать существующие стратегии управления рисками, а также обеспечивать ответственное использование технологий.

Риски, связанные с принятием ИИ. ИИ становится все более важным инструментом в различных сферах экономики, включая финансовый сектор и деятельность центральных банков. Поэтому, крайне важно, чтобы центральные банки не только осознавали существующие риски, но и активно занимались их минимизацией.

Риски, связанные с использованием ИИ в деятельности центральных банков, представлены в таблице 1.

Таблица 1. Риски центральных банков, связанные с ИИ

|

Тип риска

|

Описание

|

В контексте

новых технологий/

в контексте ИИ |

|

Стратегический

|

Отсутствие

подхода и управления в сфере ИИ может затруднить центральным банкам

достижение их целей

|

+/+

|

|

Операционный

|

Нормативно-правовые

неопределенности; риски несоответствия из-за непрозрачности моделей ИИ;

недостатки во внутренних процессах; риски, связанные с цифровыми навыками

сотрудников; зависимость от сторонних организаций и проблемы с пропускной

способностью, возникающие из-за высокой нагрузки на обработку данных моделями

ИИ

|

+/+

|

|

Информационная

безопасность, конфиденциальность и кибербезопасность

|

Несоответствующее

использование или обращение с конфиденциальными данными, личной информацией,

моделями ИИ, раскрытие конфиденциальной информации из-за неадекватных мер

контроля кибербезопасности и уязвимостей, таких как извлечение модели и

отравление данных, все это может привести к значительным правовым и

репутационным последствиям

|

+/+

|

|

Информационные и

коммуникационные технологии (ИКТ)

|

Риски,

возникающие из-за ошибок программного обеспечения, сбоев оборудования,

неадекватного проектирования системы и проблем совместимости с новыми

технологиями, а также недостаточных мер защиты критических процессов во время

сбоев, что может повлиять на непрерывность бизнеса и эксплуатационную

устойчивость

|

+/+

|

|

Инциденты

сторонних организаций

|

Инциденты,

возникающие из-за зависимости от внешних моделей ИИ или инструментов,

разработанных сторонней организацией, включая нарушения конфиденциальности,

сбои в работе, несоответствия требованиям, угрозы кибербезопасности

|

+/+

|

|

Репутационный

|

Ущерб

репутации из-за ошибок, утечек данных или отсутствия прозрачности, особенно

из-за неадекватного контроля сложных моделей ИИ

|

+/+

|

|

Модели ИИ

|

Включают

проблемы интерпретации и надежности из-за неточных результатов и моделей

«черного ящика», а также проблемы прозрачности и подотчетности из-за

самомодификации алгоритма ИИ. Этические

проблемы возникают из-за потенциальных предубеждений и ненадлежащих результатов

ИИ

|

/+

|

В таблице 1 представлены ключевые риски, с которыми сталкиваются центральные банки при внедрении технологий ИИ. Эти риски охватывают стратегические, операционные, информационные и репутационные аспекты, а также вопросы этики и законодательства. По отношению к этим рискам центральные банки обязаны разработать четкие стратегии, обеспечить защиту данных и повысить прозрачность алгоритмов. При разработке стратегии управления рисками в области ИИ ключевым аспектом должна стать поддержка внедрения моделей и инструментов ИИ с помощью комплексной системы управления рисками (СУР), и содержать в себе следующие разделы:

1. Определение профиля риска ИИ.

В целом, профиль риска ИИ включает в себя комплекс процессов:

– оценка и мониторинг рисков, связанных с ИИ, и их воздействие на финансово-экономические бизнес-процессы;

– разработка этических стандартов для использования ИИ в банковских учреждениях;

– обучение и повышение квалификации банковских сотрудников основам работы с ИИ и управления рисками, связанными с его использованием;

– сотрудничество с финансовыми регуляторами для обеспечения соблюдения нормативных актов и регламентирующих стандартов.

2. Идентификация, оценка и выбор проектов ИИ.

Этот процесс начинается с выявления и анализа вариантов использования ИИ, инициатив и проектов, их классификации по уровню риска в зависимости от конфиденциальности информации, используемой для их обучения и данных, генерируемых моделью.

3. Использование и адаптация существующих моделей управления менеджментом.

Применение и модификация уже существующих моделей управления необходимы как для их целостности, так и для согласованности. К примеру, банковская модель трех линий защиты, распределяющая функции управления и контроля на три различных уровня, должна быть адаптирована и использована для уточнения ролей и обязанностей в управлении рисками ИИ [4]. Автором предлагается актуализировать банковскую модель трех линий защиты относительно ИИ в следующей редакции (табл. 2).

Таблица 2. Актуализированная банковская модель трех линий защиты относительно ИИ

|

Функции

|

Актуализация

|

|

Первой линии

защиты

|

Определить

сценарии использования ИИ, инициативы и проекты, соответствующие стратегии

центрального банка, добавляющие инновационную значимость.

Провести оценку рисков (идентификацию, анализ), учитывая специфические для ИИ угрозы и уязвимости, и определить, соответствуют ли сценарии использования риск-аппетиту. Внедрить новые средства контроля на основе анализа сильных и слабых сторон, возможностей и угроз (SWOT-анализ), такие как тестирование надежности модели ИИ, проверка данных обучения и результатов, а также методы обнаружения предвзятости. Задействовать механизмы непрерывного мониторинга для обнаружения проблем производительности и безопасности. Обеспечить регулярное обновление технических и риск-управленческих навыков. |

|

Второй линии

защиты

|

Поддерживать

первую линию, чтобы определить, соответствует ли вариант использования,

инициатива или проект риск-аппетиту и профилю центрального банка.

Разработать институциональную методологию управления рисками, координировать выполнение оценок рисков, сделанных первой линией, и приоритизировать риски на основе профиля риска ИИ. Обновлять существующие политики и разрабатывать новые руководящие принципы для устранения рисков, специфичных для ИИ, обеспечивая при этом этичное и безопасное использование. Контролировать соблюдение нормативных актов и этических принципов. Анализировать правовую базу в соответствии с контекстами финансового сектора и центрального банка. Разрабатывать и предоставлять учебные материалы по рискам, специфичным для ИИ, и повышать осведомленность. |

|

Третьей линии

защиты

|

Осуществлять

проверки, направленные на оценку систем контроля безопасности, а также на

анализ справедливости, прозрачности и этических аспектов моделей ИИ.

Проводить обзоры и давать рекомендации по совершенствованию систем контроля и политик в области ИИ, учитывая сопутствующие риски. |

4. Защита информации на протяжении всего жизненного цикла ИИ.

Защита информации в банковском секторе на протяжении всего жизненного цикла ИИ является критически важной задачей, требующей системного подхода, включающего как технические меры, так и организационные процессы, в том числе:

– при разработке ИИ-систем важно учитывать безопасность данных, используемых для обучения моделей. Это включает в себя: анонимизацию данных, шифрование, контроль доступа;

– при внедрении ИИ-систем в банковские процессы необходимо обеспечить: тестирование на уязвимости, обучение сотрудников, соблюдение нормативных требований;

– во время эксплуатации ИИ-систем следует поддерживать высокий уровень безопасности: мониторинг и аудит, обновление и патчинг, реакция на инциденты;

– при обновлении ИИ-систем или их выводе из эксплуатации организовать безопасное удаление данных, анализ рисков, документирование процессов.

Комплекс мер по управлению ИИ в деятельности центральных банках с учётом аспектов развития и безопасности. Прежде чем предложить комплекс мер по управлению внедрением ИИ в деятельность центральных банков, рассмотрим международные стандарты в области ИИ [12-14]:

– ISO/IEC 42001 – Информационные технологии – ИИ – система управления;

– ISO/IEC 23894 – Информационные технологии – ИИ – руководство по управлению рисками;

– ISO/IEC 38507 – Информационные технологии – управление ИТ – последствия управления использованием ИИ организациями.

ISO/IEC 42001 – этот международный стандарт содержит требования и рекомендации по созданию, внедрению, поддержанию и постоянному совершенствованию системы управления ИИ в организации. Документ предназначен для использования любым учреждением (государственного/частного сектора), независимо от характера деятельности.

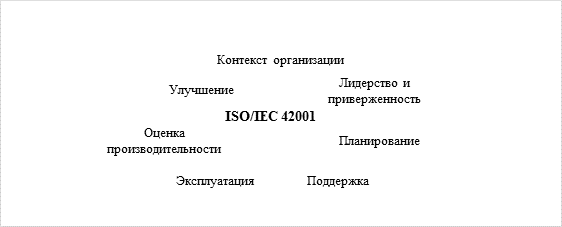

Стандарт состоит из семи ключевых компонентов (рис. 1).

Рисунок 1. Ключевые компоненты международного стандарта ISO/IEC 42001

Источник: составлено автором по материалам «Information technology – artificial intelligence – management system», ISO/IEC 42001:2023 [14].

Контекст организации. Организациям необходимо актуализировать как внутренние, так и внешние факторы, оказывающие влияние на их системы ИИ, включая обязательства, вытекающие из нормативных актов и договоров.

Лидерство и приверженность. Совет директоров обязан создать политику конфиденциальности, определить роли и обязанности, обеспечить внедрение требований систем ИИ в существующие процессы организации.

Планирование. Содержит определение рисков и возможностей, связанных с обработкой персональных данных, постановку целей для систем ИИ и разработку мероприятий по минимизации этих рисков.

Поддержка. Это связано с приобретением необходимых ресурсов для систем ИИ, включая наем персонала с соответствующими навыками и компетенциями, обеспечение осведомленности и коммуникации о политиках и процедурах конфиденциальности, а также ведение документации.

Эксплуатация. Стандарт описывает процессы и элементы управления, необходимые для соответствия требованиям систем ИИ (защита данных по умолчанию и по проекту, проведение оценок воздействия на защиту данных и управление их утечками и инцидентами).

Оценка производительности. Организации должны контролировать, измерять, анализировать и оценивать производительность своих систем ИИ (проводить внутренние аудиты, управленческие обзоры, измерять эффективность контроля и процедур конфиденциальности).

Улучшение. Стандарт подчеркивает необходимость постоянного улучшения систем ИИ. Отдельные мероприятия связаны с выявлением разногласий и принятием корректирующих мер, а также с проактивным поиском способов совершенствования практик управления конфиденциальностью.

В соответствии с подходом, изложенным в ISO/IEC 31000 – Управление рисками [11], стандарт ISO/IEC 23894 интегрирует специфические аспекты, касающиеся внедрения систем ИИ в классическую структуру управления рисками.

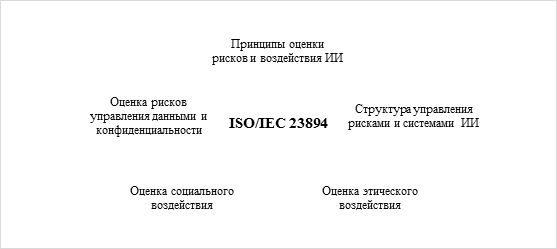

На рисунке 2 отражены процедуры, необходимые для адаптации существующих структур управления рисками с учетом внедрения технологий ИИ.

Рисунок 2. Ключевые компоненты международного стандарта ISO/IEC 23894

Источник: составлено автором по материалам «Information technology – artificial intelligence – guidance on risk management», ISO/IEC 23894:2023 [13].

Принципы оценки рисков и воздействия ИИ. Учитывая преимущества интегрированной структуры управления рисками, стандарт излагает руководящие принципы относительно процессов оценки рисков и влияния ИИ в организациях. К таким принципам относятся динамичность, применение наиболее актуальной информации, инклюзивность, непрерывное улучшение и учет человеческих/культурных факторов.

Структура управления рисками и системами ИИ. Стандарт содержит рекомендации по модификации существующей системы управления рисками с целью охвата технологий ИИ, например, обеспечение интеграции рисков в бизнес-процессы, поддержание ответственности руководства за этичное внедрение ИИ, адекватное отражение внешних и внутренних условий, определение ролей, подотчетности и распределения ресурсов.

Оценка этического воздействия. Стандарт акцентирует внимание на потенциальном влиянии внедрения ИИ на людей, включая предвзятость алгоритмов, обработку личных данных и даже последствия для основных прав и физической безопасности.

Оценка социального воздействия. Разработка и использование ИИ может повлиять на социальные и культурные ценности населения, поэтому важно, чтобы организации учитывали этот вид воздействия при оценке рисков.

Оценка рисков управления данными и конфиденциальности. С учетом особенностей и объема данных, требуемых для работы систем ИИ, организациям следует оценивать и снижать риски, связанные с управлением данными и защитой конфиденциальности, особенно при использовании больших наборов данных для обучения систем ИИ.

В документе стандарта ISO/IEC 38507 концентрируется внимание на том, что организациям следует сохранять существующие принципы управления (человеческий контроль и ответственность за автоматизированные процессы принятия решений, при выполнении как текущих, так и новых внутренних и внешних обязательств). Для обеспечения соблюдения лучших практик им необходимо рассмотреть возможность создания детализированной карты систем ИИ (экосистемы ИИ), функционирующих в учреждении.

Основные элементы стандарта представлены на рисунке 3.

Рисунок 3. Ключевые компоненты международного стандарта ISO/IEC 38507

Источник: составлено автором по материалам «Information technology – governance of IT – governance implications of the use of artificial intelligence by organizations», ISO/IEC 38507:2022 [12].

Сохранение управления. Принимая во внимание потенциальное влияние на деятельность организации, стандарт содержит рекомендации по оценке адекватности текущей структуры управления в контексте внедрения ИИ.

Обязанности руководящего органа. Стандарт определяет роли и обязанности руководящего органа в надзоре за инициативами ИИ. Он подчеркивает важность разработки/пересмотра структур управления, полномочий для принятия решений и систем подотчетности в условиях технологической зависимости, прозрачности и объяснимости, которые требуются системам ИИ.

Стратегия и инвестиции в ИИ. Стандарт содержит рекомендации для руководящего органа по формированию стратегии использования ИИ в организации, чтобы гарантировать, что инвестиции в эту технологию соответствуют долгосрочным целям и уровню допустимого риска.

Обзор политик и управление принятием решений. Руководящий орган обязан разработать надлежащую политику, определить цепочку ответственности и обеспечить человеческий надзор за безопасным использованием ИИ, поскольку автоматизированные решения, принимаемые системами ИИ, не освобождают его от ответственности.

Управление данными. Процессы сбора, обработки и хранения данных должны быть улучшены для обеспечения качества обработки и вывода данных.

Соответствие. Руководящий орган должен иметь гарантии того, что руководство поддерживает систему ИИ, используемую организацией для выполнения обязательств по соблюдению и избежания несоответствия.

Управление рисками. Руководящий орган должен понимать допустимость рисков, принимая во внимание установленный уровень аппетита к риску.

Источники рисков. Руководящий орган должен быть осведомлён о рисках, которые зависят от особенностей и сферы применения системы ИИ и от уровня зрелости технологий, применяемых в организации.

Принимая во внимание рассмотренные международные стандарты в области ИИ, можно предложить следующий комплекс мер по управлению внедрением ИИ в деятельности центральных банков с учетом аспектов развития и безопасности:

– разработать и внедрить этические принципы, определяющие приемлемые способы использования ИИ в деятельности центральных банков;

– обеспечить соответствие использования ИИ законодательству и нормативным актам, регулирующим деятельность центральных банков;

– разработать систему управления рисками, включающую оценку потенциальных рисков, связанных с ИИ, и меры по их минимизации;

– учитывать возможные ошибки и сбои в работе ИИ, а также риски, связанные с безопасностью данных;

– обеспечивать прозрачность и подотчётность в использовании ИИ, предоставляя информацию о том, как он применяется в деятельности центральных банков и какие результаты он даёт;

– инвестировать в развитие компетенций сотрудников центральных банков в области ИИ для обеспечения его эффективного использования;

– создать специализированные подразделения по управлению ИИ;

– обеспечить сформированные подразделения необходимыми ресурсами для эффективного выполнения своих функций;

– внедрить системы мониторинга и оценки рисков в отношении ИИ;

– обеспечить безопасность и конфиденциальность данных;

– реализовать меры по защите данных от несанкционированного доступа, утечки и других угроз;

– соблюдать требования законодательства о защите персональных данных.

Заключение

Центральные банки все чаще используют ИИ для улучшения качества данных, операций и поддержки принятия решений. ИИ предоставляет интеллектуальные инструменты для решения сложных проблем в таких областях, как анализ данных, оценка рисков, прогнозирование, обслуживание клиентов и корпоративные услуги. Тем не менее, применение инструментов ИИ формирует новые риски и потенциально усугубляет существующие. Такие риски эффективнее контролировать комплексно – на этапах проектирования, внедрения и эксплуатации. Риски информационной безопасности заслуживают особого упоминания, учитывая критичность и конфиденциальность информации, обрабатываемой центральными банками. В целом, центральные банки могли бы начать использовать ИИ в менее критических процессах, где риски легче контролировать.

Безопасное внедрение ИИ может охватывать следующие области:

– управление;

– нормативно-правовое соответствие;

– информационная безопасность и конфиденциальность;

– кибербезопасность;

– управление рисками третьих лиц;

– непрерывность бизнеса;

– другие операционные риски, связанные с уровнем цифровизации и уязвимостью организации.

Учитывая преобразующий потенциал технологий ИИ, как с точки зрения их влияния на бизнес, так и внешних эффектов для общества, создание структуры управления для внедрения ИИ имеет первостепенное значение для центральных банков. Это подразумевает пересмотр политик, связанных с различными процессами управления и операционными процедурами организации, включая системы управления рисками, соответствие и управление данными, а также обеспечение прозрачности и коммуникации с заинтересованными сторонами.

Практические аспекты, изложенные в международных стандартах, могут служить отправной точкой. Эти практики содержат:

– системное управление рисками – обновление систем для интеграции ИИ с обеспечением надежных методов управления рисками;

– соответствие требованиям и обслуживание данных – обеспечение соответствия систем ИИ существующим правилам и поддержание высоких стандартов целостности и конфиденциальности данных;

– прозрачность и коммуникация – повышение прозрачности в процессах принятия решений ИИ и эффективное информирование об этих процессах внутренней и внешней аудитории.

Международные стандарты и передовая практика позволят центральным банкам лучше интегрировать ИИ в свои структуры управления, гарантируя его безопасное, ответственное и этичное использование.

[1] Организация экономического сотрудничества и развития (ОЭСР/OECD) – международная экономическая организация развитых стран.

Источники:

2. Бостром Н. Искусственный интеллект. Этапы. Угрозы. Стратегии. / Перевод с английского. - М.: Манн, Иванов и Фербер, 2016. – 404 c.

3. Ларионова И.В. Как сохранить доверие населения к участникам финансового рынка // Сберегательное дело за рубежом. – 2020. – № 2. – c. 3-10. – doi: 10.36992/75692_2020_2_3.

4. Лев М.Ю., Медведева М.Б., Лещенко Ю.Г. Оценка устойчивости коммерческого банка в аспекте экономической и финансовой безопасности // Экономическая безопасность. – 2023. – № 1. – c. 173-200. – doi: 10.18334/ecsec.6.1.117469.

5. Лев М.Ю., Болонин А.И., Ермоловская О.Ю., Лещенко Ю.Г. Институционально-технологические аспекты CBDC: конфиденциальность, безопасность, масштабируемость // Экономическая безопасность. – 2024. – № 5. – c. 1207-1224. – doi: 10.18334/ecsec.7.5.121077.

6. Лев М.Ю., Болонин А.И., Туруев И.Б., Лещенко Ю.Г. Концепция искусственного интеллекта в деятельности центральных банков: институциональные возможности // Экономическая безопасность. – 2024. – № 4. – c. 781-808. – doi: 10.18334/ecsec.7.4.120831.

7. Лев М.Ю., Лещенко Ю.Г., Медведева М.Б. Регулирование искусственного интеллекта международными организациями как фактор обеспечения технологической безопасности в национальных юрисдикциях // Экономическая безопасность. – 2024. – № 8. – c. 1999-2026. – doi: 10.18334/ecsec.7.8.121608.

8. Терентьева О.И. Платежные инновации, инициируемые ведущими мировыми центробанками // Сберегательное дело за рубежом. – 2021. – № 1. – c. 3-8. – doi: 10.36992/75692_2021_1_3.

9. Шестак В.А., Волеводз А.Г. Современные потребности правового обеспечения искусственного интеллекта: взгляд из России // Всероссийский криминологический журнал. – 2019. – № 2. – c. 197-206. – doi: 10.17150/2500-4255.2019.13(2).197-206.

10. Baker-Brunnbauer Josef Trustworthy Artificial Intelligence Implementation: Introduction to the TAII Framework (Business Guides on the Go). Amazon.com. [Электронный ресурс]. URL: https://www.amazon.com/Trustworthy-Artificial-Intelligence-Implementation-Introduction/dp/303118274X (дата обращения: 05.02.2025).

11. International Organization for Standardization and International Electrotechnical Commission (2018): «ISO 31000:2018 Risk management – Guidelines». Iso.org. [Электронный ресурс]. URL: https://www.iso.org/standard/65694.html (дата обращения: 25.02.2025).

12. International Organization for Standardization and International Electrotechnical Commission (2022): «Information technology – governance of IT – governance implications of the use of artificial intelligence by organizations». Iso/iec. [Электронный ресурс]. URL: https://www.iso.org/standard/56641.html (дата обращения: 25.02.2025).

13. International Organization for Standardization and International Electrotechnical Commission (2023): «Information technology – artificial intelligence – guidance on risk management». Iso/iec. [Электронный ресурс]. URL: https://www.iso.org/standard/77304.html (дата обращения: 25.02.2025).

14. International Organization for Standardization and International Electrotechnical Commission (2023): «Information technology – artificial intelligence – management system». Iso.org. [Электронный ресурс]. URL: https://www.iso.org/standard/81230.html (дата обращения: 25.02.2025).

15. Recommendation of the Council on Artificial Intelligence. Oecd. [Электронный ресурс]. URL: https://legalinstruments.oecd.org/en/instruments/OECD-LEGAL-0449 (дата обращения: 05.02.2025).

16. Njoroge Lucas Role of Artificial Intelligence (AI) in Central Banking: Implications for COMESA Member Central Banks. Comesa.int. [Электронный ресурс]. URL: https://www.comesa.int/wp-content/uploads/2020/09/Special-Report-AI-and-Big-Data-Implication-for-Central-Banking-in-COMESA-region.pdf (дата обращения: 05.02.2025).

Страница обновлена: 04.06.2026 в 04:30:19

Download PDF | Downloads: 34

Managing the implementation of artificial intelligence in central banks, including development and security issues

Akopov V.S.Journal paper

Economic security

Volume 8, Number 2 (February 2025)

Abstract:

The relevance of the study lies in the feasibility of integrating AI technologies into the activities of central banks, taking into account their impact on financial and economic stability, security and social responsibility.

The article presents the theoretical context of AI and defines its benefits for central banks. The risks for central banks associated with the adoption of AI are identified. The need to develop a risk management strategy for AI is argued.

International standards in the area of AI, including systemic risk management, are considered.

Taking into account existing international standards, a set of measures to manage the implementation of AI in central banks, including the development of security aspects, is proposed.

The conclusion is drawn that international standards and best practices will enable central banks to better integrate AI into their governance structures and ensure its safe, responsible and ethical use.

Keywords: artificial intelligence, development, security, central bank, risk management

JEL-classification: E58, E50, G32, L86

References:

Baker-Brunnbauer Josef Trustworthy Artificial Intelligence Implementation: Introduction to the TAII Framework (Business Guides on the Go)Amazon.com. Retrieved February 05, 2025, from https://www.amazon.com/Trustworthy-Artificial-Intelligence-Implementation-Introduction/dp/303118274X

Bolonin A.I., Bolonina S.E., Leschenko Yu.G. (2023). The monitoring of financial innovation in the central banks’ statistics. Informatization in the Digital Economy. 4 (2). 119-138. doi: 10.18334/ide.4.2.118424.

Bostrom N. (2016). Iskusstvennyĭ intellekt. Etapy. Ugrozy. Strategii [Artificial intelligence. Stages. Threats. Strategies] M.: Mann, Ivanov i Ferber.

International Organization for Standardization and International Electrotechnical Commission (2018): «ISO 31000:2018 Risk management – Guidelines»Iso.org. Retrieved February 25, 2025, from https://www.iso.org/standard/65694.html

International Organization for Standardization and International Electrotechnical Commission (2022): «Information technology – governance of IT – governance implications of the use of artificial intelligence by organizations»Iso/iec. Retrieved February 25, 2025, from https://www.iso.org/standard/56641.html

International Organization for Standardization and International Electrotechnical Commission (2023): «Information technology – artificial intelligence – guidance on risk management»Iso/iec. Retrieved February 25, 2025, from https://www.iso.org/standard/77304.html

International Organization for Standardization and International Electrotechnical Commission (2023): «Information technology – artificial intelligence – management system»Iso.org. Retrieved February 25, 2025, from https://www.iso.org/standard/81230.html

Larionova I.V. (2020). How to maintain public confidence in financial market participants. Sberegatelnoe delo za rubezhom. (2). 3-10. doi: 10.36992/75692_2020_2_3.

Lev M.Yu., Bolonin A.I., Ermolovskaya O.Yu., Leschenko Yu.G. (2024). Institutional and technological aspects of CBDC: confidentiality, security and scalability. Economic security. 7 (5). 1207-1224. doi: 10.18334/ecsec.7.5.121077.

Lev M.Yu., Bolonin A.I., Turuev I.B., Leschenko Yu.G. (2024). The concept of artificial intelligence in the activities of central banks: institutional opportunities. Economic security. 7 (4). 781-808. doi: 10.18334/ecsec.7.4.120831.

Lev M.Yu., Leschenko Yu.G., Medvedeva M.B. (2024). Regulation of artificial intelligence by international organizations as a factor in ensuring technological security in national jurisdictions. Economic security. 7 (8). 1999-2026. doi: 10.18334/ecsec.7.8.121608.

Lev M.Yu., Medvedeva M.B., Leschenko Yu.G. (2023). Assessing the sustainability of a commercial bank in terms of economic and financial security. Economic security. 6 (1). 173-200. doi: 10.18334/ecsec.6.1.117469.

Njoroge Lucas Role of Artificial Intelligence (AI) in Central Banking: Implications for COMESA Member Central BanksComesa.int. Retrieved February 05, 2025, from https://www.comesa.int/wp-content/uploads/2020/09/Special-Report-AI-and-Big-Data-Implication-for-Central-Banking-in-COMESA-region.pdf

Recommendation of the Council on Artificial IntelligenceOecd. Retrieved February 05, 2025, from https://legalinstruments.oecd.org/en/instruments/OECD-LEGAL-0449

Shestak V.A., Volevodz A.G. (2019). Modern requirements of the legal support of artificial intelligence: a view from Russia. Vserossiĭskiĭ kriminologicheskiĭ zhurnal. 13 (2). 197-206. doi: 10.17150/2500-4255.2019.13(2).197-206.

Terenteva O.I. (2021). Payment innovations initiated by the world's leading central banks. Sberegatelnoe delo za rubezhom. (1). 3-8. doi: 10.36992/75692_2021_1_3.